Во время презентации Google I/O 2024 общий тон звучал так: «Можем ли мы расширить?» Обещанные Google улучшения искусственного интеллекта определенно занимают здесь центральное место, но, за некоторыми исключениями, большинство из них все еще находится в стадии разработки.

Это не так уж удивительно – в конце концов, это конференция разработчиков. Но, похоже, потребителям придется еще немного подождать обещанного момента «Ее». Вот чего вы можете ожидать, когда начнут появляться новые функции Google.

ИИ в поиске Google

Автор: Google/YouTube

Автор: Google/YouTube

Возможно, самым впечатляющим дополнением для большинства людей станет расширенная интеграция Gemini в поиск Google. Хотя у Google уже есть «генеративный поиск»; Функция, позволяющая быстро записать один или два абзаца, скоро к ней присоединится «Обзоры AI».

Обзоры AI при желании расширят генеративный поиск на всю страницу, с ответами на ваши вопросы в виде а также предложения, основанные на контексте вашего поиска.

Например, если вы живете в солнечном районе с хорошей погодой и спрашиваете «рестораны рядом с вами»; Обзоры могут дать вам несколько основных рекомендаций, а также отдельный подзаголовок с ресторанами, в которых есть хорошие места для сидения во внутреннем дворике.

Вместо этого на более традиционной странице результатов поиска вы сможете использовать “AI организованные результаты поиска»,” которые избегают традиционного SEO и разумно рекомендуют вам веб-страницы на основе конкретных подсказок.

Например, вы можете попросить Google “составить трехдневный план питания без глютена с большим количеством овощей и, по крайней мере, два десерта», и на странице поиска будет создано несколько подзаголовков со ссылками на соответствующие рецепты под каждым.

Google также внедряет искусственный интеллект в процесс поиска, уделяя особое внимание мультимодальности – это означает, что вы можете использовать его не только с текстом. В частности, опция «Спросить с помощью видео»; В разработке находится функция, которая позволит вам просто навести камеру телефона на объект, запросить помощь в идентификации или ремонте и получить ответы с помощью генеративного поиска.

Google не рассказал напрямую, как он справляется с критикой в отношении того, что результаты поиска ИИ по сути крадут контент из источников в сети, при этом пользователям не нужно переходить по исходному источнику. Тем не менее, демонстранты неоднократно подчеркивали, что эти функции приводят вас к полезным ссылкам, которые вы можете проверить самостоятельно, возможно, прикрывая свою базу перед лицом этой критики.

Обзоры с использованием искусственного интеллекта уже внедряются в экспериментальных лабораториях поиска Google, а результаты организованного поиска с использованием искусственного интеллекта и функция «Спросить с помощью видео» будут доступны «на ближайшие недели».

Выполняйте поиск по фотографиям. с ИИ

Фото: Google/YouTube

Фото: Google/YouTube

Еще одна из более конкретных функций в разработке — это функция «Спросить фотографии». который использует мультимодальность, чтобы помочь вам разобраться в сотнях гигабайт изображений на вашем телефоне.

Предположим, ваша дочь брала уроки плавания в прошлом году, и вы потеряли из виду свои первые фотографии ее в воде. С помощью функции «Спросить фотографии» вы можете просто спросить: «Когда моя дочь научилась плавать?» Ваш телефон автоматически определит, кого вы подразумеваете под словом «ваша дочь», и покажет фотографии с ее первого урока плавания.

Это похоже на поиск в вашей библиотеке фотографий фотографий вашей кошки, просто набрав “cat,” конечно, но идея состоит в том, что мультимодальный ИИ может отвечать на более подробные вопросы и понимать, о чем вы спрашиваете, используя более широкий контекст, опираясь на Gemini и данные, уже хранящиеся на вашем телефоне.

Другие детали незначительны, с Ask Photos, дебют которых состоится “в ближайшие месяцы”

Проект Астра: агент ИИ в вашем кармане

Фото: Google/YouTube

Фото: Google/YouTube

Здесь мы переходим к более подробному описанию «небесного пирога». Проект Астра — это самый большой C-3PO, который мы когда-либо видели ИИ. Идея состоит в том, что вы сможете загрузить приложение Gemini на свой телефон, открыть камеру, навести ее и задавать вопросы и оказывать помощь в зависимости от того, что видит ваш телефон.

Например, наведите указатель на динамик, и Astra сможет сказать вам, какие части оборудования есть и как они используются. Укажите на рисунок кота с сомнительной живучестью, и Астра ответит на вашу загадку с помощью «Кота Шрёдингера». Спросите его, где ваши очки, и если Астра смотрела на них ранее в вашем кадре, он вам ответит.

Возможно, это классическая мечта, когда дело касается ИИ, и она очень похожа на недавно анонсированный OpenAI GPT-4o, поэтому вполне логично, что он еще не готов. Astra должна появиться «позже в этом году»; но любопытно, что он также должен работать как на очках AR, так и на телефонах. Возможно, мы скоро узнаем о новом носимом устройстве Google.

Создайте собственный подкаст, размещенный роботами

Фото: Google/YouTube

Фото: Google/YouTube

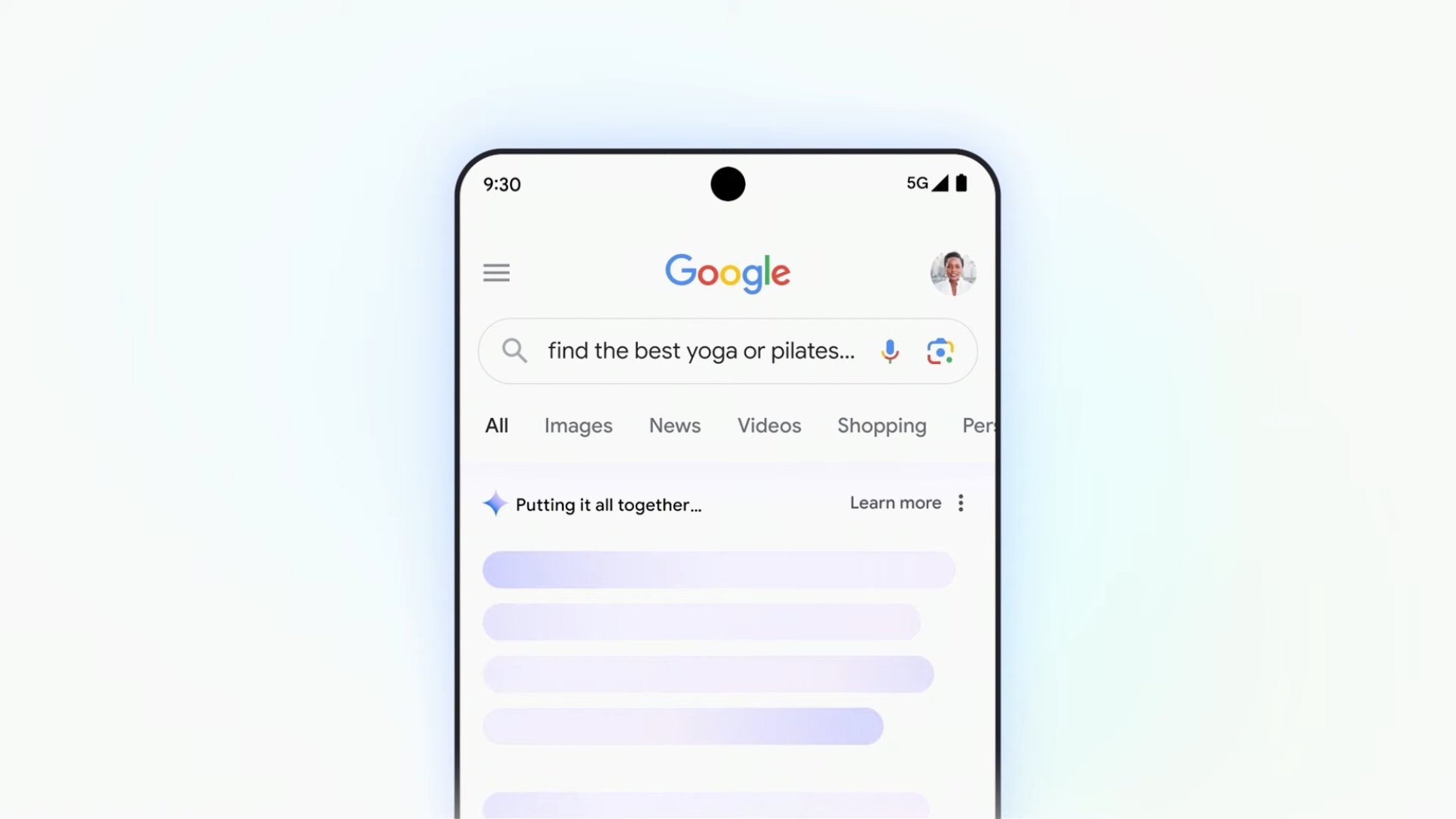

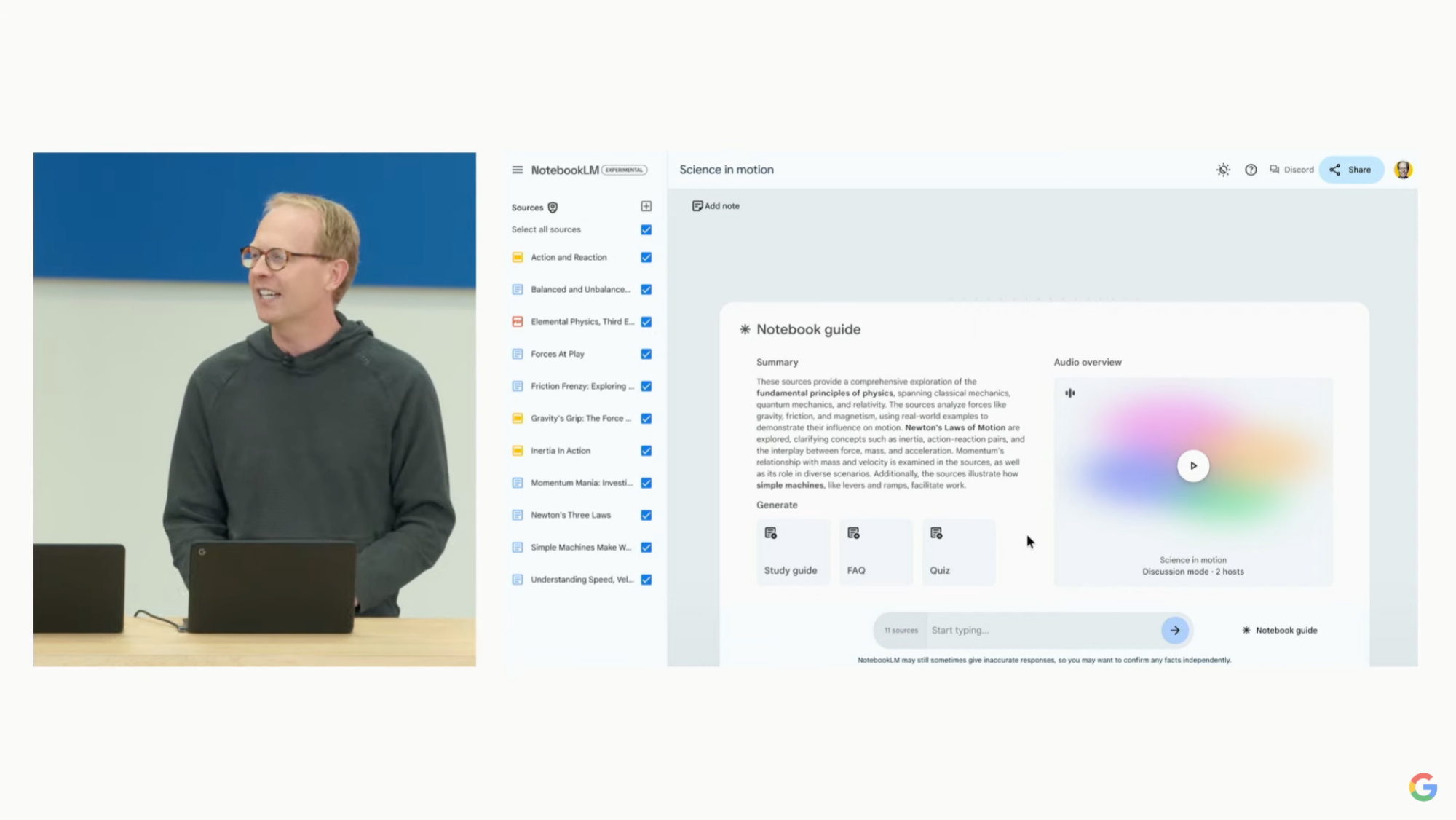

Пока неясно, когда эта функция будет готова, поскольку она, похоже, является скорее примером улучшенных моделей искусственного интеллекта Google, чем хедлайнером, но это одна из наиболее впечатляющих (и, возможно, тревожных) демонстраций, которые Google продемонстрировал во время Ввод-вывод включал создание собственного подкаста, размещаемого голосами искусственного интеллекта.

Предположим, ваш сын изучает физику в школе, но учится больше аудио, чем тексту. Предположительно, Gemini скоро позволит вам загружать записанные PDF-файлы в приложение Google NotebookLM и просить Gemini создать аудиопрограмму для их обсуждения. Приложение создаст нечто похожее на подкаст, организованный голосами искусственного интеллекта, которые естественным образом обсуждают темы из PDF-файлов.

Ваш сын сможет в любой момент прервать ведущих, чтобы попросить разъяснений.

Ваш сын сможет в любой момент прервать ведущих.

Ваш сын сможет в любой момент прервать ведущих.

п><р>Галлюцинации, очевидно, являются здесь серьезной проблемой, и натуралистический язык может показаться немного «съёживающимся». за неимением лучшего слова. Но нет никаких сомнений в том, что это впечатляющая демонстрация… если бы мы только знали, когда сможем воссоздать ее.

Платные функции

Фото: Google/YouTube

Фото: Google/YouTube

В разработке находится еще несколько инструментов, которые кажутся специально созданными для типичного потребителя, но на данный момент они будут ограничены платными планами Google Workspace.

Наиболее многообещающие из них. — это интеграция Gmail, которая использует трехсторонний подход. Первый — это сводки, которые можно прочитать в ветке Gmail и выделить для вас ключевые моменты. Это не так уж и ново, как и второй вариант, который позволяет ИИ предлагать вам контекстные ответы на основе информации в других ваших электронных письмах.

Но вопросы и ответы Близнецов кажутся действительно преобразующими. Представьте, что вы хотите выполнить кровельные работы и уже отправили электронное письмо трем разным строительным фирмам с запросом цен. Теперь вы хотите составить электронную таблицу по каждой фирме, ее заявленной цене и доступности. Вместо того, чтобы просматривать вместе с ними каждое ваше электронное письмо, вы можете попросить поле Gemini в нижней части Gmail создать для вас эту таблицу. Он выполнит поиск в вашем почтовом ящике Gmail и сформирует таблицу за считанные минуты, что сэкономит ваше время и, возможно, поможет найти пропущенные письма.

Подобный вид построения контекстных таблиц также появится в приложениях за пределами Gmail, но Google также с гордостью продемонстрировал своего нового «Virtual Gemini Powered Teammate». Эта грядущая функция Workspace все еще находится на ранней стадии и представляет собой смесь типичного чата Gemini и Astra. Идея состоит в том, что организации смогут добавлять агентов искусственного интеллекта к своим аналогам в Slack, которые будут готовы отвечать на вопросы и создавать документы круглосуточно, 7 дней в неделю.

Функции Gmail Gemini будут доступны пользователям Workspace Labs в этом месяце.

Gems

Фото: Google/YouTube

Фото: Google/YouTube

Ранее в этом году OpenAI заменила плагины ChatGPT на “GPT” позволяя пользователям создавать собственные версии чат-ботов ChatGPT, предназначенные для решения конкретных вопросов. Gems — это ответ Google на этот вопрос, и они работают примерно так же. Вы сможете создать несколько драгоценных камней, каждый из которых будет иметь собственную страницу в вашем интерфейсе Gemini и каждый будет отвечать на определенный набор инструкций. В демо-версии Google предлагаемые Gems включали такие примеры, как «Yoga Bestie» и «Yoga Bestie». который предлагает советы по упражнениям.

Gems — еще одна функция, которая увидит свет лишь через несколько месяцев, поэтому пока вам придется придерживаться GPT.

Агенты

Фото: Google/YouTube <р>Сразу после приглушенного приема Humane AI Pin и Rabbit R1, поклонники ИИ надеялись, что Google I/O покажет ответ Gemini на обещания, стоящие за этими устройствами, то есть способность выйти за рамки простого сопоставления информации и фактически взаимодействовать с веб-сайтами. для тебя. В результате мы получили легкий тизер без указания даты выпуска.

Фото: Google/YouTube <р>Сразу после приглушенного приема Humane AI Pin и Rabbit R1, поклонники ИИ надеялись, что Google I/O покажет ответ Gemini на обещания, стоящие за этими устройствами, то есть способность выйти за рамки простого сопоставления информации и фактически взаимодействовать с веб-сайтами. для тебя. В результате мы получили легкий тизер без указания даты выпуска.

В заявлении генерального директора Google Сундара Пичаи мы увидели намерение компании создать агентов искусственного интеллекта, которые смогут «думать на несколько шагов вперед». Например, Пичаи рассказал о возможности будущего агента Google AI, который поможет вам вернуть обувь. Это может быть «поиск квитанции в вашем почтовом ящике»; вплоть до «заполнения формы возврата»; и «запланировать самовывоз»; все под вашим контролем.

Все это имело одну оговорку: это была не демо-версия, а просто пример того, над чем Google хочет работать. «Представьте, если бы Близнецы могли бы» Во время этой части мероприятия проделал большую тяжелую работу.

Новые модели искусственного интеллекта Google

Фото: Google/YouTube

Фото: Google/YouTube

Помимо выделения конкретных функций, Google также рекламировал выпуск новых моделей ИИ и обновления существующей модели ИИ. От генеративных моделей, таких как Imagen 3, до более крупных и более контекстуально интеллектуальных сборок Gemini — эти аспекты презентации были предназначены больше для разработчиков, чем для конечных пользователей, но есть еще несколько интересных моментов, на которые стоит обратить внимание.

Ключевыми отличиями являются появление Veo и Music AI Sandbox, которые генерируют AI-видео и звук соответственно. Подробностей о том, как они работают, пока не так много, но Google привлек таких крупных звезд, как Дональд Гловер и Вайклеф Джин, за многообещающие цитаты вроде: «Каждый станет режиссером»; и «Мы копаемся в бесконечных ящиках».

На данный момент лучшие демо-версии этих генеративных моделей, которые у нас есть, представлены в примерах, размещенных на каналах знаменитостей на YouTube. Вот один из них ниже:

Google также не перестанет говорить о Gemini 1.5 Pro и 1.5 Flash во время своей презентации. Новые версии LLM в первую очередь предназначены для разработчиков, которые поддерживают большее количество токенов, что обеспечивает большую контекстуальность. . Вероятно, для вас это не будет иметь большого значения, но обратите внимание на Gemini Advanced.

Gemini Advanced уже доступен на рынке как платный план Gemini от Google и позволяет задавать большее количество вопросов, легкое взаимодействие с Gemini 1.5, интеграцию с различными приложениями, такими как Документы (отдельно от эксклюзивных функций Workspace), и загрузку файлов. например PDF-файлы.

Некоторые из обещанных Google функций звучат так, будто для них потребуется подписка Gemini Advanced, особенно те, которые требуют, чтобы вы загружали документы, чтобы чат-бот мог отвечать на связанные с ними вопросы или рифмовать. от них своим собственным содержанием. Мы еще не знаем наверняка, что будет бесплатным, а что нет, но это еще одно предостережение, которое следует иметь в виду, чтобы Google “следил за нами” обещает этот ввод-вывод.

На этом общие объявления Google о Gemini завершаются. Тем не менее, они также объявили о новых функциях искусственного интеллекта в Android, включая новую возможность «Круг для поиска» и использование Gemini для обнаружения мошенничества. (Однако это не новости об Android 15: это будет завтра.)

lifehacker.com